3. Il riconoscimento facciale

su migranti e persone straniere in Italia

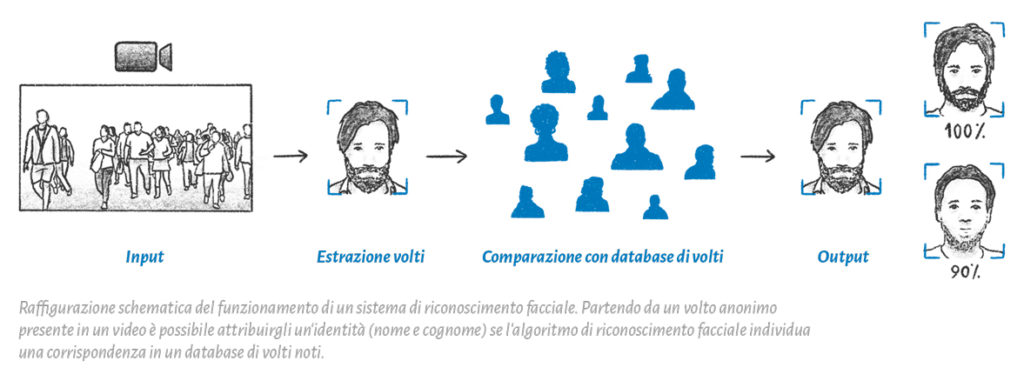

Dal 2018 la polizia italiana utilizza un sistema di riconoscimento facciale chiamato S.A.R.I. (Sistema Automatico di Riconoscimento Immagini) per identificare, durante le indagini, un soggetto ignoto confrontando la foto del suo volto con quelle collezionate nella banca dati AFIS. Il sistema è in grado di fornire un elenco di immagini ordinato secondo un grado di similarità; i suoi risultati sono poi analizzati dagli operatori specializzati della Polizia scientifica. La composizione di questo database, la mancanza di informazioni e analisi sull’accuratezza degli algoritmi utilizzati e l’assenza di risposte da parte delle forze dell’ordine sollevano necessarie preoccupazioni sui rischi che il sistema SARI può introdurre quando utilizzato su migranti e persone straniere presenti in Italia.

Cos’è SARI?

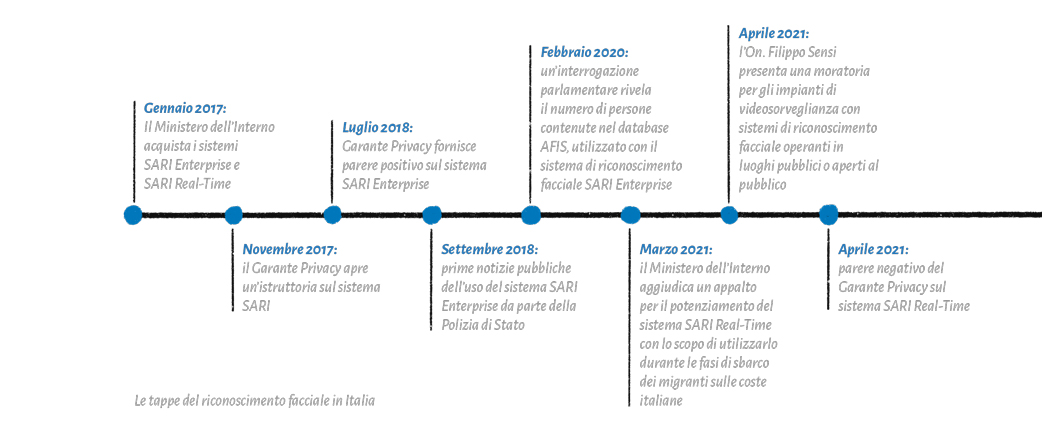

Il Ministero dell’Interno ha acquistato il sistema SARI a gennaio 2017 aggiudicando l’appalto all’azienda Parsec 3.26, azienda che collabora con l’Istituto di Scienze Applicate e Sistemi Intelligenti del Consiglio Nazionale delle Ricerche (CNR ISASI) per lo sviluppo di algoritmi di riconoscimento facciale. Il sistema SARI presenta due diversi moduli: SARI Enterprise e SARI Real-Time. Il primo modulo permette di confrontare l’immagine di un sospetto, acquisita ad esempio dalle videocamere a circuito chiuso, e confrontarla con immagini di volti presenti in una banca dati di grandi dimensioni già in possesso della polizia. Il SARI Real-Time, invece, è in grado di analizzare in tempo reale i volti dei soggetti ripresi dalle telecamere installate in un determinato luogo e di confrontarli con una watch-list la cui grandezza è dell’ordine delle decine di migliaia di soggetti.

SARI Enterprise è utilizzato durante le indagini mentre SARI Real-Time, secondo quanto scritto nell’appalto del Ministero, è pensato “a supporto di operazioni di controllo del territorio in occasione di eventi e/o manifestazioni” poiché l’algoritmo genera degli alert quando nel video appaiono individui presenti nella watch-list. Dal punto di vista legale,la polizia ha ricevuto l’approvazione dal Garante privacy per l’utilizzo di SARI Enterprise a luglio 2018. Nel provvedimento il Garante riconosce che il sistema automatizza semplicemente un’attività che le forze di polizia hanno sempre svolto manualmente—la ricerca dei volti per anagrafica e dettagli in AFIS.

Per SARI Real-Time, invece, il Garante Privacy si è espresso nell’aprile 2021 definendo il sistema di riconoscimento facciale, così come progettato, una possibile forma di sorveglianza e identificazione di massa che non può essere utilizzata dal Ministero dell’Interno perché non vi è una base legale per il trattamento di dati biometrici da parte delle forze dell’ordine.

Nel parere del Garante si legge: “l’identificazione di una persona in un luogo pubblico comporta il trattamento biometrico di tutte le persone che circolano nello spazio pubblico monitorato, al fine di generare i modelli di tutti per confrontarli con quelli delle persone incluse nella watch-list. Pertanto, si determina una evoluzione della natura stessa dell’attività di sorveglianza, passando dalla sorveglianza mirata di alcuni individui alla possibilità di sorveglianza universale allo scopo di identificare alcuni individui.”

Provvedimento del garante della privacy contro l’utilizzo del sistema di riconoscimento facciale Sari Real-Time, aprile 2021.

Allo stato attuale, quindi, in Italia le forze dell’ordine possono utilizzare solo il riconoscimento facciale per l’identificazione in differita di un soggetto, dopo che questi ha commesso un reato. Non è possibile utilizzare sistemi di riconoscimento facciale per generare degli alert in tempo reale. Malgrado ciò, i sistemi in uso rischiano di avere comunque un impatto sproporzionato sulla popolazione straniera in Italia e, malgrado lo stop del Garante, le intenzioni del Ministero dell’Interno sembrano essere quelle di estendere l’uso di questa tecnologia, fatto che emerge da alcune risposte a interrogazioni parlamentari sul tema di cui parleremo nei paragrafi successivi.

Chi subisce il riconoscimento facciale in Italia?

Da un’analisi dei comunicati stampa delle Questure italiane emerge che il sistema SARI Enterprise è ampiamente utilizzato nelle attività di polizia e, in alcuni casi, le persone identificate sono cittadini stranieri presenti in Italia: tra i soggetti coinvolti vi sono persone di etnia rom, persone di origine algerina, e persone nate in Italia da genitori stranieri. Non sempre però la polizia spiega il motivo per cui l’immagine è già presente nel database AFIS. In alcuni casi è indicato che i soggetti coinvolti sono stati già fotosegnalati in precedenza per aver commesso altri reati ma spesso questo dettaglio manca nelle descrizioni dei comunicati stampa. I soggetti presenti in AFIS rientrano però anche in altre categorie.

Secondo quanto previsto dal “Testo unico delle disposizioni concernenti la disciplina dell’immigrazione e norme sulla condizione dello straniero” (D.Lgs 286/1998), chi richiede il permesso di soggiorno o chi ne richiede il rinnovo è sottoposto a fotosegnalamento. Inoltre, vi rientrano anche le persone che chiedono protezione internazionale.

Ad agosto 2021, secondo quanto riportato dal Corriere della Sera, il sistema SARI avrebbe aiutato la polizia milanese a risolvere un caso di stupro. La persona arrestata, un cittadino egiziano, sarebbe stata fotosegnalata due volte, la prima al momento dello sbarco a Lampedusa e, successivamente, quando ha presentato richiesta di protezione internazionale a Milano. L’immagine del volto sarebbe stata confrontata con la foto del profilo WhatsApp dell’indagato. Non è ancora chiaro il ruolo giocato dal software di riconoscimento facciale: la polizia infatti era già in possesso del numero di telefono del sospettato, che era già attenzionato dalla polizia stessa; è stata inoltre effettuata una verifica del DNA prelevato di nascosto da una lattina ed un mozzicone di sigaretta ma non è chiaro se questa verifica sia avvenuta dopo l’impiego del software di riconoscimento facciale o in contemporanea.

Questo caso mostra però come il bacino di soggetti presenti nel database AFIS usato nelle indagini della polizia includa un ampio spettro di categorie: dal soggetto che ha commesso reati ed è stato sottoposto a fotosegnalamento alla persona che chiede protezione internazionale una volta arrivata sul suolo italiano.

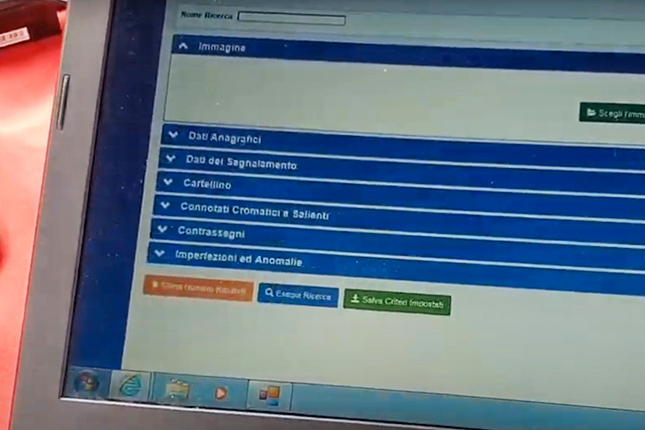

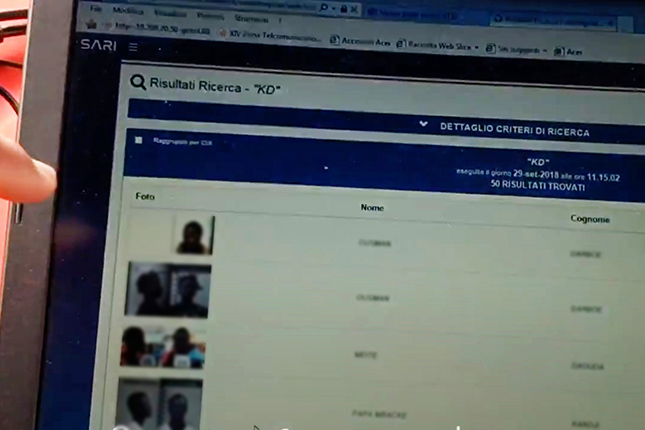

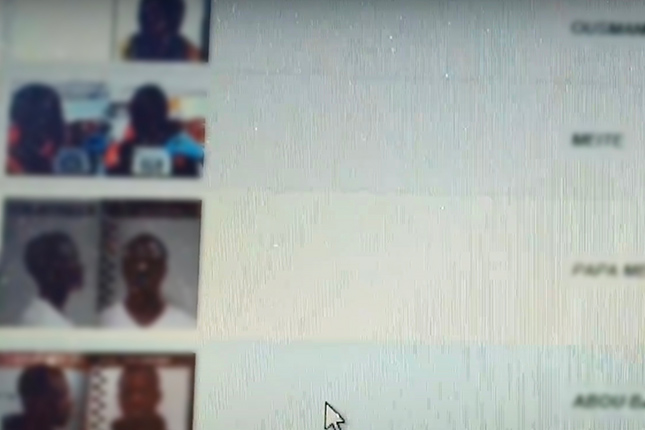

La presenza di migranti all’interno del database AFIS è confermata anche da un frame di una video-intervista a un ufficiale di polizia. Nel video caricato online l’ufficiale mostra il funzionamento del sistema SARI Enterprise effettuando una ricerca di un volto. Tra i risultati presentati dall’algoritmo vi è la foto di una persona scattata all’aperto, con altre persone alle spalle, dove si vede una mano che indossa un guanto monouso sorreggere un numero identificativo. La foto sembrerebbe quindi ritrarre una procedura di fotosegnalamento dei migranti effettuata allo sbarco, come indicato nelle Procedure Operative Standard pubblicate dal Ministero dell’Interno.

La raccolta delle immagini dei volti dei migranti e la loro inclusione nel database AFIS erano già stati sottolineati nel lavoro della Commissione parlamentare di inchiesta sul sistema di accoglienza, di identificazione ed espulsione, nonché sulle condizioni di trattenimento dei migranti e sulle risorse pubbliche impegnate che aveva lavorato sia alla gestione dei dati statistici relativi al fenomeno migratorio sia al sistema di identificazione e prima accoglienza negli hotspot. In particolare, durante i lavori della Commissione, vi era stata l’audizione di Daniela Stradiotto, Direttrice del servizio di Polizia Scientifica della Polizia di Stato riguardo le procedure di fotosegnalamento e problemi relativi all’impiego della forza per raccogliere l’impronta e la foto del soggetto. Il resoconto stenografico dell’audizione riporta le parole della direttrice in merito:

“Se uno chiude gli occhi, è praticamente impossibile riuscire ad aprirglieli e a tenerli aperti, se non falsando una fotografia. Se continua a girare la testa, io non posso tenergliela bloccata. Adesso si fotografa la parte frontale, il di fronte, e il profilo destro.”

Resoconto stenografico dell’audizione della dottoressa Daniela Stradiotto, direttrice del servizio di Polizia scientifica della Polizia di Stato.

L’impiego della forza nelle procedure di identificazione e fotosegnalamento sono già state oggetto di un’interrogazione parlamentare nel giugno 2016. Recentemente, con l’introduzione delle navi quarantena a seguito della pandemia da COVID-19, ASGI ha segnalato come in un primo momento le amministrazioni avessero riferito che le procedure di identificazione e fotosegnalamento venissero svolte direttamente a bordo delle navi quarantena. Queste dichiarazioni sono successivamente state chiarite segnalando che nella maggioranza dei casi sono effettuate prima del trasferimento sulle navi, ad esempio presso gli hotspot.

I numeri del riconoscimento facciale in Italia

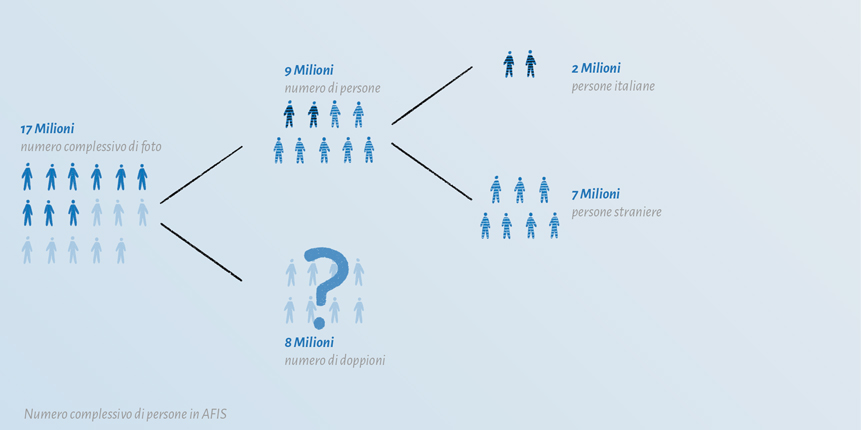

Comprendere la composizione del database AFIS utilizzato con il sistema di riconoscimento facciale SARI è fondamentale per capire quali rischi corrono le persone che vi sono incluse. Il database AFIS è utilizzato durante le indagini per cercare l’identità di un sospetto tra volti già noti alle autorità per aver commesso dei reati: includere nello stesso database migranti e richiedenti asilo rischia quindi di criminalizzare ulteriormente proprio quei soggetti deboli che dovrebbero ricevere più protezioni e maggiori salvaguardie. Secondo un’inchiesta della testata giornalistica Wired Italia 8 persone su 10 presenti nel database AFIS sarebbero stranieri, ovvero circa 2 milioni di cittadini italiani e 7 milioni di persone con cittadinanza diversa da quella italiana. Sempre secondo Wired, la condizione necessaria per essere inclusi nel database su cui lavora SARI è essere soggetti alla raccolta delle impronte digitali e fotosegnalati. Le fotografie raccolte durante le manifestazioni di piazza, le foto dei passaporti e delle carte di identità non finiscono in quel database.

Un dettaglio puntuale sul numero di persone incluse nel database AFIS viene dalla risposta del Ministero dell’Interno a un’interrogazione parlamentare fatta nei primi mesi del 2020. Nella risposta si legge:

“nella banca dati Afis sono presenti, attualmente, 17.592.769 cartellini fotosegnaletici, acquisiti a norma di legge, corrispondenti a 9.882.490 individui diversi, di cui 2.090.064 si riferiscono a cittadini italiani.”

Risposta del Ministero dell’Interno all’interrogazione parlamentare dell’On Sensi, 5 febbraio 2020.

Anche in questo caso, la nazionalità delle persone sulle quali l’algoritmo di SARI effettua la ricerca e le motivazioni della loro inclusione nel database non è stata chiarita.

Per comprendere meglio quali soggetti sono inclusi nel database, il Centro Hermes ha inviato richieste di accesso civico generalizzato alla Divisione Anticrimine di 22 diverse Questure presenti sul territorio italiano, chiedendo il dettaglio della nazionalità delle persone presenti nel database AFIS, statistiche sull’utilizzo del sistema SARI Enterprise e numero complessivo delle ricerche effettuate che hanno portato all’arresto del ricercato o si sono rivelate utili nelle indagini. Negli 11 casi in cui il team di ricerca ha ricevuto risposte, le Questure hanno negato l’accesso ai dati “al fine di evitare un pregiudizio concreto alla tutela dell’interesse pubblico inerente all’ordine ed alla sicurezza pubblica.” Inoltre, i dati sulle ricerche che hanno portato ad arresti sono considerati “risultati operativi” e quindi non diffondibili.

Quanti errori commette SARI?

Allo stato attuale è quindi impossibile avere numeri sulla nazionalità delle persone incluse nel database AFIS e soprattutto le motivazioni che giustificano l’inserimento nel database. Questo quadro deve farci preoccupare ulteriormente perché non sono disponibili valutazioni aggiornate degli algoritmi del sistema SARI.

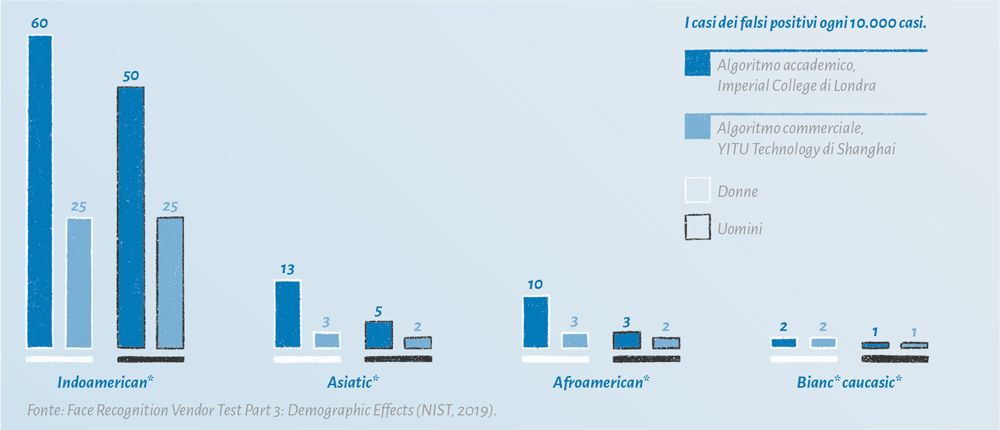

Da anni, ricercatori e attivisti sottolineano come queste tecnologie di analisi biometrica siano pericolose e inefficaci soprattutto per quelle persone che si discostano dallo standard occidentale della persona bianca. Studi pubblicati dal Massachusetts Institute of Technology (MIT) e dalla Stanford University dimostrano come i sistemi di riconoscimento facciale in commercio commettano sistematicamente più errori quando si tratta di riconoscere volti di persone non bianche; e che gli errori aumentano se si tratta di volti di donne o entra in gioco la variabile dell’età della persona raffigurata in foto. Al momento in Italia c’è il rischio che un richiedente asilo possa essere fermato e interrogato dalla polizia solo perché l’algoritmo del sistema SARI ha indicato un match con la foto di una persona indagata, persona con la quale condivide solamente il colore della pelle. Secondo quanto riportato nell’offerta tecnica dell’azienda Parsec 3.26, il sistema SARI Enterprise utilizza due diversi algoritmi: uno prodotto dall’azienda Neurotechnology e l’altro prodotto dalla stessa Parsec 3.26, chiamato Reco.

In un articolo pubblicato da Motherboard Italia si sottolinea come le uniche valutazioni pubblicamente disponibili dell’algoritmo Reco risalgono al 2016. In quello studio l’algoritmo è stato testato su 3 diversi database: uno contenente foto di volti scattate frontalmente, il secondo con volti in diverse posizioni, e l’ultimo con immagini di volti raccolti direttamente dal web. Quando l’algoritmo è usato in un database che contiene volti di persone non bianche la probabilità di individuare la persona cercata tra i primi 10 risultati è di circa il 77%. Nello stesso articolo, la polizia ha inoltre dichiarato che le valutazioni degli algoritmi sono dati tecnici delicati che non possono essere divulgati. Nell’appalto per l’acquisto del sistema SARI, la polizia ha richiesto che uno degli algoritmi offerti fosse selezionato tra quelli valutati nel report “Face Recognition Vendor Test (FRVT)” effettuato dal National Institute of Standards and Technology (NIST) e pubblicato nel maggio 2014.

Il secondo algoritmo usato nel sistema SARI Enterprise, offerto da Parsec 3.26, è prodotto dall’azienda Neurotechnology. Secondo i risultati del report di NIST, Neurotechnology è indicata tra le aziende i cui algoritmi non sono tra quelli più accurati. NIST sottolinea però che le prestazioni non sono univoche e qualsiasi classifica deve essere ponderata in base ai requisiti specifici dell’applicazione: ad esempio alcuni algoritmi sono più adatti al riconoscimento di immagini prese dalle webcam mentre altri possono essere più veloci. Di particolare importanza, però, è il numero di immagini usate nel database per i test: nel caso del report di NIST ci sono 1,6 milioni di immagini mentre nel database usato con SARI le immagini sono più di 9 milioni. Come sottolinea il report NIST, “più identità sono registrate in un sistema biometrico e più alta è la possibilità di un falso positivo.”

A distanza di 3 anni dal primo utilizzo del sistema SARI, la polizia scientifica non ha però pubblicato alcun tipo di analisi sull’accuratezza e sul tasso di falsi positivi del sistema quando l’algoritmo è applicato su un database chiaramente più grande e composto in modo diverso da quello testato nella valutazione NIST, e non è chiaro se gli algoritmi siano stati modificati e aggiornati. A garanzia del corretto utilizzo del sistema di riconoscimento facciale, la polizia scientifica sottolinea che il sistema offre una lista di persone che potrebbero corrispondere a quella ricercata e che solo ufficiali addestrati ed esperti possono confermare la validità dei risultati offerti dall’algoritmo. Non è chiaro però il contenuto dei materiali di addestramento per l’uso del sistema SARI, quanto spesso vengano effettuati gli addestramenti e quanti sono gli ufficiali esperti in analisi forense in grado di poter effettuare la valutazione. Il risultato del matching del sistema SARI è considerato quindi come un indizio aggiuntivo e non una prova schiacciante.

Al momento, effettuando una ricerca sui principali quotidiani nazionali e tra i casi giudiziari giunti alla Corte Suprema di Cassazione, in Italia non sembrano ancora esserci stati episodi in cui il sistema SARI ha condotto all’arresto della persona sbagliata né episodi in cui una persona è stata interrogata dalla polizia solamente sulla base della decisione dell’algoritmo di riconoscimento facciale. Chiaramente questa valutazione non è da considerarsi definitiva: negli Stati Uniti ci sono almeno tre casi di persone nere, di cui almeno una africano-americana, che sono state erroneamente fermate, interrogate e persino arrestate sulla base dei risultati di sistemi di riconoscimento facciale che sono stati applicati alla lettera dalla polizia. In un caso l’arrestato avrebbe scoperto l’errore solo perché uno degli ufficiali di polizia ha fatto esplicito riferimento alla decisione di un computer.

Vista la mancanza di valutazioni pubbliche ufficiali sull’accuratezza del sistema SARI Enterprise in Italia, e considerando che gli algoritmi di riconoscimento facciale presentano generalmente una percentuale di falsi positivi maggiore nei casi in cui i volti appartengono a persone non bianche, non possiamo escludere che episodi simili a quelli negli Stati Uniti siano già avvenuti o possano verosimilmente accadere, soprattutto per quanto riguarda le misure di fermo di indiziato, precedenti a una eventuale convalida di arresto e nomina di un avvocato difensore. Per quanto riguarda il valore della prova fornita dal sistema SARI, invece, alcuni passaggi di una sentenza del luglio 2020 della Corte Suprema di Cassazione sottolineano quanto già riportato in precedenza da questa ricerca, ovvero che si tratta di un indizio debole. Nella sentenza si legge che, in un caso di omicidio, il Tribunale di Milano aveva sottolineato che

“le immagini poste a base del riconoscimento non erano nitide e non consentivano di riconoscere le fattezze, l’abbigliamento e diversi particolari dell’accoltellatore, per cui non era sostenibile la sussistenza di elementi gravi.”

Un passaggio della sentenza n.21823 della Corte Suprema di Cassazione, luglio 2020.

SARI contro i migranti e le intenzioni del Ministero dell’Interno

Alla luce della mancanza di trasparenza sulle capacità del sistema SARI Enterprise, desta ulteriore preoccupazione l’annuncio del Ministero dell’Interno di voler potenziare il sistema SARI Real-Time per usarlo sui migranti allo scopo di monitorare le fasi di sbarco. Nel marzo 2021 la Direzione Centrale dell’Immigrazione e della Polizia delle Frontiere ha pubblicato un esito di gara sulla Gazzetta Ufficiale della Repubblica Italiana aggiudicando l’appalto alla ditta RECO 3.26, collegata alla ditta Parsec 3.26 e focalizzata sull’offerta di sistemi di riconoscimento facciale.

Un’inchiesta di IrpiMedia ha rivelato a gennaio 2021 i dettagli tecnici del bando e ha mostrato come, malgrado all’epoca il Ministero fosse ancora in attesa di una valutazione su SARI Real-Time da parte del Garante per la protezione dei dati personali, il sistema fosse già pronto per un potenziamento. Il Ministero dell’Interno ha stanziato 246 mila euro per due obiettivi: potenziare il sistema SARI Enterprise da usare anche per la verifica dell’autenticità delle foto nei documenti, e usare SARI Real-Time come

“sistema tattico per monitorare le operazioni di sbarco e tutte le varie tipologie di attività illegali correlate, video riprenderle ed identificare i soggetti coinvolti.”

Come riportato nella scheda tecnica allegata al bando, il sistema—che include anche videocamere e altre componenti hardware—deve essere di ridotte dimensioni, da portare in uno zaino, e permettere di

“effettuare installazioni strategiche in luoghi difficilmente accessibili con le apparecchiature in dotazione.”

Questo bando è parte del progetto Falco Extended finanziato dal Fondo Sicurezza Interna (FSI) 2014-2020 creato dalla Commissione Europea, la quale offre 4 miliardi di euro per promuovere diversi obiettivi, tra cui la gestione delle frontiere esterne dell’Unione Europea. Il progetto Falco Extended si è aggiudicato 4 milioni di euro in Italia e prevede, oltre al potenziamento del sistema SARI, anche un bando per l’accesso alla banca dati mondiale riguardante persone giuridiche a scopo di indagini patrimoniali e un servizio di interpretariato.

Al momento, grazie anche alla decisione del Garante privacy di fermare l’avvio del sistema SARI Real-Time, il riconoscimento facciale in tempo reale e quello pensato per monitorare le fasi di sbarco sulle coste italiane non possono essere usati. Malgrado ciò, le intenzioni del Ministero dell’Interno destano notevoli preoccupazioni. In risposta ad un’interrogazione parlamentare dell’On. Filippo Sensi, la Ministra Luciana Lamorgese ha presentato quelle che sarebbero dovute essere delle rassicurazioni ma che in realtà rivelano un desiderio di introdurre un uso più ampio di questa tecnologia. Inizialmente, infatti, la ministra ribadisce che il sistema SARI non è in uso nell’ambito della Direzione centrale dell’immigrazione e della polizia delle frontiere e che

“non ha ambiti diversificati a seconda dei soggetti (cittadini italiani, migranti ecc.).” In un passaggio successivo, però, spiega che SARI “è un sistema che a regime funzionerà in modo indifferenziato a supporto delle attività investigative.”

Risposta della ministra Lamorgese all’interrogazione parlamentare dell’On. Filippo Sensi, 3 marzo 2021.

Nel caso degli sbarchi dei migranti sulle coste italiane, come ricorda la direttrice della scientifica nell’audizione alla Commissione parlamentare, per ogni sbarco

“viene aperto un fascicolo in procura perché […] si tratta di un’ipotesi di reato—il cosiddetto book, in cui ci sono gli stranieri scesi e quelli che non si vogliono far fotosegnalare.”

Resoconto stenografico dell’audizione della dottoressa Daniela Stradiotto, direttrice del servizio di Polizia scientifica della Polizia di Stato.

Inoltre, le procedure operative standard pubblicate dal Ministero dell’Interno sottolineano come ci sia sempre personale supplementare durante gli sbarchi

“posto a disposizione delle autorità italiane ai fini della organizzazione delle attività di competenza in relazione alla fase di sbarco (Squadra Mobile, Digos, ecc.).”

Al momento quindi, qualora fosse introdotta in Italia una base giuridica per il trattamento dei dati biometrici tramite sistemi di riconoscimento facciale in tempo reale, il Ministero dell’Interno sembrerebbe essere a favore dell’uso di questa tecnologia in ogni attività investigativa, incluse anche quelle che ruotano intorno alla fase di sbarco sulle coste italiane. D’altra parte, il Sottosegretario di Stato per l’Interno, Carlo Sibilia, interpellato il 24 settembre 2021 sulla posizione del Governo rispetto alla necessità di una moratoria sui sistemi di riconoscimento facciale, ha ribadito che la biometria e l’impiego dell’intelligenza artificiale in tutti gli ambiti hanno

“un impatto profondo sulle società contemporanee” e che “in gioco non sono solo lo sviluppo e la competitività mondiale, ma anche e, soprattutto, la tenuta dei principi democratici.” Di fatto però non sembrano esserci elementi che mostrino l’intenzione di adottare una moratoria: lo sforzo del Governo, nelle parole di Sibilia, è di definire “regole capaci di coniugare livelli crescenti di benessere, resi possibili dalla tecnologia, con i princìpi basilari e i diritti fondamentali di libertà di una società aperta.”

Il Parlamento italiano ha però mostrato sensibilità sul tema e ha introdotto una moratoria su alcuni casi specifici a inizio dicembre 2021. La moratoria riguarda solo i sistemi di videosorveglianza con riconoscimento facciale, e le autorità di polizia e i pubblici ministeri sono esentati dal divieto temporaneo. Per quanto riguarda i migranti, quindi, l’impiego e i rischi del sistema Sari Enterprise e del database AFIS descritti in questa ricerca rimangono. Allo stato attuale, in Italia possiamo escludere l’impiego diretto e specifico di sistemi di riconoscimento facciale in tempo reale sui migranti.

Gli effetti indiretti della sorveglianza biometrica, però, rischiano di investire comunque migranti e richiedenti asilo poiché le immagini dei loro volti sono incluse in un database utilizzato con il sistema di riconoscimento facciale SARI Enterprise. In questo modo la criminalizzazione della persona straniera è inscritta nell’infrastruttura tecnologica italiana: i dati biometrici raccolti al momento dello sbarco sono inclusi in un database che contiene potenziali sospetti e, senza la corretta supervisione degli algoritmi usati, potrebbe produrre dei falsi positivi violando i diritti di categorie di persone che dovrebbero essere particolarmente protette.